Section 1.2 Méthodes de volumes finis pour les lois scalaires

On va maintenant introduire la discrétisation classique pour ce type de problème. Il s'agit de la méthode des volumes finis.

Subsection 1.2.1 Méthodes des volumes finis

Les méthodes de réduction d'ordre que nous introduirons par la suite utilisent des "snapshots" donc des exemples de simulations pour construire les modèles réduits. Il faut donc être capable de résoudre le problème d'origine. On va donc introduire des méthodes numériques pour les lois de conservations introduites précédemment (1.1.1). On ne détaillera pas les méthodes types éléments finis peu utilisées pour les lois de conservations. La méthode des volumes finis est la méthode principale pour résoudre des lois de conservation nonlinéaire. Elle utilise la propriété de conservation des équations. Elle est considérée comme très robuste, mais peu précise. On considère un maillage 1D composée de \(n+1\) noeuds \(n\) et de \(n\) mailles. On appelle \(x_j\) avec \(j\in\left\{1,N\right\}\) les centres de chaque maille et \(x_{j\pm\frac12}\) les noeuds qui forment l'interface gauche et droite de la maille \(j\text{.}\) Pour construire la méthode, on commence par intégrer l'équation dans la maille \(\Omega_j\text{.}\) On obtient

Afin de pouvoir écrire un schéma on va définir le degré de liberté de la méthode. Ici il s'agit de choisir la valeur moyenne de \(\rho\) dans chaque maille:

On va donc construire une approximation constante par maille. Une fois ce degré de liberté définit l'équation (1.2.1) se réécrit en utilisant le théorème de Green qui relie l'intégrale d'une divergence à une intégrale de bord. On obtient

Cependant écrit comme cela le système n'est pas fermé, car nous obtenons une relation entre valeurs moyennes et valeurs ponctuelles, mais qui ne nous permet pas de calculer l'une ou l'autre. Pour fermer le problème, on propose l'approximation suivante:

et

On appelle \(g(\rho_l,\rho_r)\) et \(g_d(\rho_l,\rho_r)\) des flux numériques qui modélise le flux d'information entre deux unités de volumes (ici les mailles).

Définition 1.2.1.

Un flux est dit consistant pour l'équation (1.1.1) si

Tout l'enjeu de la méthode des volumes finis est de construire ce flux numérique. Le choix le plus naturel est de choisir les flux suivants:

et

Pour le premier flux, la consistance se retrouve formellement avec la méthode du point milieu en intégration. La seconde se retrouve à l'aide de développement de Taylor comme vu avec les différences finies (voir cours de rappel)

Lemme 1.2.2.

Quelque soit le flux numérique utilisé dans le schéma discret en espace et continue en temps, on peut écrire cela sous la forme:

on obtient formellement:

On parle de schémas conservatifs.

Les résultats numériques précédemment montrent une instabilité lorsque le Reynolds est trop petit. Cela vient du fait que fondamentament le flux dit centré (1.2.5) est instable. Cela peut se régler avec un schéma implicite, mais les résultats restent très mauvais lorsqu'on une discontinuité apparaît. Pour traiter les régimes avec de grand Reynolds (voir sans viscosité) qui génère des chocs il faut des flux adaptés pour la partie hyperbolique. C'est ce qu'on va rapidement introduire maintenant. On considérera pour les moments le modèle sans terme dissipatif. Dans la suite, on va considérer une loi de conservation scalaire générale de type (1.1.1). Comme on vient de le voir, le schéma devient instable lorsque la dissipation physique devient trop petite. Une idée naturelle sera donc d'ajouter de la dissipation au schéma centrée et de la construire minimale pour assurer la stabilité. On considère le flux générique (flux de Lax-Friedrich global):

Pour le problème linéaire qui conserve la norme \(L^2\) on assure la stabilité en faisant décroître la norme \(L^2\) discrète. La conservation n'est pas possible à cause des erreurs d'arrondis. Il nous faut un équilavent en nonlinéaire. Pour les lois de conservations de type (1.1.1) on sait que les solutions entropiques satisfont

pour les solutions régulières et

de façon générale. L'idée est d'essayer de préserver cette propriété au niveau discret afin de capturer les solutions entropiques.

Définition 1.2.4.

Soit l'équation (1.1.1) muni du couple entropie - flux entropique \((\eta,\zeta))\text{.}\) Soit un flux numérique associé \(g_{j+\frac12}(\rho_j,\rho_{j+1})\) tel que

Le schéma associé à ce flux est dit entropique si et seulement si il existe une flux entropique \(\zeta_{j+\frac12}(\rho_j,\rho_{j+1})\) tel que

Proposition 1.2.5.

On définit

On suppose que \(\forall \rho\in [m,M], \quad f^{'}(\rho)\ge 0\text{.}\)

Si \(\frac{c\Delta t}{\Delta x}\le 1\) et \(\underset{m\le x\le M}{max}\mid f^{'}(x)\mid \leq c\) alors la solution donnée par (1.2.8) satisfait

et si \(\frac{c\Delta t}{\Delta x}\le \frac12\) elle satisfait aussi l'inégalité d'entropie (1.2.9) avec

Preuve.

-

Démonstration du principe du maximum:

On écrit le temps \(n+1\) en fonction du temps \(n\text{.}\) On obtient

\begin{equation} \rho_j^{n+1}=\rho_j^n+\frac{c\Delta t}{2\Delta x}(\rho_{j+1}^n-2\rho_j^n+\rho_{j-1}^n)- \frac{\Delta t}{2\Delta x}[f(\rho_{j+1}^n)-f(\rho_{j-1}^n)]\tag{1.2.12} \end{equation}\begin{equation} \rho_j^{n+1}=\rho_j^n+\frac{c\Delta t}{2\Delta x}(\rho_{j+1}^n-2\rho_j^n+\rho_{j-1}^n)- \frac{\Delta t}{2\Delta x}[a_j^n(\rho_{j+1}^n-\rho_{j-1}^n)]\tag{1.2.13} \end{equation}avec \(a_j^n=\frac{f(\rho_{j+1}^n)-f(\rho_{j-1}^n)}{(\rho_{j+1}^n-\rho_{j-1}^n)}\text{.}\) Par le théorème des accroissements finis il existe un \(b_j^n\) tel que

\begin{equation*} a_j^n=f^{'}(b_j^n), \quad min(\rho_{j-1}^n,\rho_{j+1}^n))\le b_j^n \le max(\rho_{j-1}^n,\rho_{j+1}^n)) \end{equation*}Maintenant on réécrit (1.2.13) ce qui donne

\begin{equation} \rho_j^{n+1}=[1-\frac{c\Delta t}{\Delta x}]\rho_{j}^n +\frac{\Delta t}{2\Delta x}[c-a_j^n]\rho_{j+1}^n+\frac{\Delta t}{2\Delta x}[c+a_j^n]\rho_{j-1}^n\tag{1.2.14} \end{equation}La condition CFl assure que \([1-\frac{c\Delta t}{\Delta x}]>0\text{.}\) La condition sur \(c\) assure que \((c\pm a_j^n)>0\text{.}\) On a donc une combinaison convexe donc

\begin{equation} min(\rho_{j-1}^n,\rho_{j}^n,\rho_{j+1}^n) \le \rho_j^{n+1}\le max(\rho_{j-1}^n,\rho_{j}^n,\rho_{j+1}^n)\tag{1.2.15} \end{equation}En itérant en temps, on conclut.

-

Démonstration de la propriété d'entropie

On commence par réécrire le schéma en posant \(\nu = \frac{\Delta t}{\Delta x}\) afin d'obtenir

\begin{equation*} \rho_j^{n+1}=\frac12(\rho_j^n+\nu c(-\rho_j^n+\rho_{j-1}^n) -\nu (f(\rho_j^n)-f(\rho_{j-1}^n)) ) + \frac12(\rho_j^n+\nu c(\rho_{j+1}^n-\rho_{j}^n) -\nu (f(\rho_{j+1}^n)-f(\rho_{j}^n)) ) \end{equation*}Par convexité de l'entropie on obtient

\begin{equation*} \eta(\rho_j^{n+1})\le \frac12\eta(\rho_j^n+\nu c(-\rho_j^n+\rho_{j-1}^n) -\nu (f(\rho_j^n)-f(\rho_{j-1}^n)) ) + \frac12\eta(\rho_j^n+\nu c(\rho_{j+1}^n-\rho_{j}^n) -\nu (f(\rho_{j+1}^n)-f(\rho_{j}^n)) ) \end{equation*}On peut réarranger les termes afin de faire apparaître l'inégalité qu'on souhaite. Dans ce cas on obtient

\begin{equation} \eta(\rho_{j}^{n+1})-\eta(\rho_{j}^{n})+\nu(\zeta_{j+\frac12}-\zeta_{j-\frac12})\leq \frac{1}{2}(\psi_{-}(\rho_{j-1}^n)+\psi_{+}(\rho_{j+1}^n))\tag{1.2.16} \end{equation}avec

\begin{equation*} \phi_{+}(\rho)=\eta(\rho+\nu c(\rho -\rho_j^n) -\nu (f(\rho) - f(\rho_j^n)) \end{equation*}\begin{equation*} -\eta(\rho_j^n)-\nu c (\eta(\rho)-\eta(\rho_j^n))+\nu (\zeta(\rho)-\zeta(\rho_j^n)) \end{equation*}et

\begin{equation*} \phi_{-}(\rho)=\eta(\rho+\nu c( -\rho_j^n+\rho) -\nu (-f(\rho) + f(\rho_j^n)) \end{equation*}\begin{equation*} -\eta(\rho_j^n)-\nu c (\eta(\rho)-\eta(\rho_j^n))+\nu (-\zeta(\rho)+\zeta(\rho_j^n)) \end{equation*}Pour conclure il suffit donc de montrer que les deux fonctions \(\phi_{\pm}\) sont négatives. Puisque qu'on sait qu'elles sont nulles en \(\rho_j^n\) on va donc montrer qu'elles sont croissantes \(\rho_j^n\) gauche de zéro et donc décroissante à droite de \(\rho_j^n\text{.}\) On commence par \(\phi_{+}\text{.}\) La dérivée de \(\phi_{+}\) est donné par

\begin{equation*} \phi_{+}^{'}(\rho)=\nu(c-f^{'}(\rho))\underbrace{[\eta^{'}(\rho_j^n+\nu c(\rho -\rho_j^n)-\nu(f(\rho)-f(\rho_j^n))) -\eta^{'}(\rho)]}_{A} \end{equation*}En utilisant la définition de \(c\) on obtient que le premier terme soit positif. On va donc se concentrer sur le terme \(A\) que l'ont va réécrire a l'ai des accroissements finis

\begin{equation*} A=\eta^{''}(a)(\rho_j^n+\nu c(\rho -\rho_j^n)-\nu(f(\rho)-f(\rho_j^n)) -\rho) \end{equation*}avec \(min(\rho,\rho^*) \lt a \lt max(\rho,\rho^{*})\) et \(\rho^{*}=\rho_j^n+\nu c(\rho -\rho_j^n)-\nu(f(\rho)-f(\rho_j^n)\text{.}\) La convexité de \(\eta\) permet d'obtenir que \(\eta^{''}(a)\) est positive. On va réécrire le second terme à l'aide d'accroissement fini sur \(f\)

\begin{equation*} A=\eta^{''}(a)(1-\nu c +\nu f^{'}(b))(\rho_j^n-\rho) \end{equation*}avec \(min(\rho_j^n,\rho) \le b \le max(\rho_j^n,\rho)\text{.}\) Puisque \(\mid f^{'}(b)\mid \lt c \) on a donc \((1-\nu c +\nu f^{'}(b)) \gt 0\) si la CFL plus stricte (avec le \(\frac12\)) est respectée. Par conséquent

\begin{equation*} \phi_{+}^{'}(\rho)=C(\rho)(\rho_j^n-\rho) \end{equation*}avec \(C(\rho) \ge 0\text{.}\) On voit donc que si \(\rho \lt \rho_j^n\) la fonction \(\phi_{+}\) est croissante et si \(\rho \gt \rho_j^n\) elle est décroissante. Puisqu’elle est nulle en \(\rho_j^n\) elle est donc toujours négative. Pour \(\phi_{-}\) le principe est le même. On commence par écrire la dérivée

\begin{equation*} \phi_{-}^{'}(\rho)=\nu(c+f^{'}(\rho))\underbrace{[\eta^{'}(\rho_j^n+\nu c(\rho -\rho_j^n)-\nu(f(\rho_j^n)-f(\rho))) -\eta^{'}(\rho)]}_{B} \end{equation*}Le premier terme est positif et le second s'écrit

\begin{equation*} B=\eta^{''}(a)(1-\nu c -\nu f^{'}(b))(\rho_j^n-\rho) \end{equation*}À partir de là on peut appliquer le même raisonnement et conclure.

Ce résultat s'interprète comme un résultat de stabilité du schéma numérique. Il est l'extension nonlinéaire de la décroissance en norme qui assure la stabilité des schémas linéaires. Un schéma peut être stable sans être entropique, mais cette propriété assure une forme assez forte de stabilité.

Théorème 1.2.6. (théorème de Lax Wendroff).

On considère \(u_h\) la solution du schéma (1.2.8) - (1.2.7) avec une condition initiale \(\rho_0 \in L^{\infty}(\mathbb{R})\text{.}\) On suppose que la condition CFL \(\frac{c\Delta t}{\Delta x}\le \frac12\) est satisfaite. Supposons qu'il existe \(\rho\in L_{loc}^1(\mathbb{R}^{+}\times \mathbb{R})\) tel que

et que \(c\) est borné alors \(\rho\in L^{\infty}(\mathbb{R}^{+}\times \mathbb{R})\) est une solution faible entropique.

Preuve.

Puisque qu'on suppose que la condition CFL est vérifiée alors en utilisant (1.2.10) on obtient une majoration du type

On prend une fonction \(C_0^{\infty}\) (à support compact). On pense ensuite \(\phi_j^n=\phi(n\Delta t,j\Delta x)\text{.}\) On introduit l'intégrale discrète de notre équation multipliée par la fonction test

Maintenant on va appliquer une intégration par partie discrète ce qui revient a un rearrangement des termes:

On va considérer le premier terme. On peut le réécrire sous forme intégrale:

avec \(v_{\Delta x,\Delta t}=\frac{\phi_j^n-\phi_j^{n-1}}{\Delta t} \chi_{x\in \Omega_j}\chi_{t\in [t_n,t_{n+1}]}\text{.}\) Puisque \(\phi\) est \(C_0^{\infty}\) on a une convergence uniforme de \(v_{\Delta x,\Delta t}\) vers la dérivée de \(\phi\) et puis que \(\rho_{\Delta x,\Delta t}\) converge dans \(L_{loc}^1\)donc

dans \(L_{loc}^1\text{.}\) Puisque \(\phi\) est infiniment dérivable à support compact alors on \(\partial_{t}\phi\) qui est borné et donc

On applique donc le Théorème de convergence dominée de Lebesgue ce qui nous donne

donc

Avec le même argument on obtient que

On va passer au dernier terme:

avec

et

On pose \(f_{\Delta x,\Delta t}=f(\rho_j^n)\chi_{x\in \Omega_j}\chi_{t\in [t_n,t_{n+1}]}\text{.}\) Avant de pouvoir traiter ce terme comme précédemment il faut montrer qu'il converge vers \(f(\rho(t,x))\text{.}\) Pour cela il suffit de remarquer que:

donc

On a donc convergence \(f_{\Delta x,\Delta t}\) vers \(f(\rho(t,x))\) dans \(L_{loc}^1\) par convergence de \(\rho_{\Delta x,\Delta t}\) dans \(L_{loc}^1\text{.}\) À partir de la, on utilise les mêmes arguments (convergence uniforme de \(\phi\text{,}\) convergence dominée, etc) pour obtenir

Maintenant il faut s'occuper du terme \(B\text{.}\) On commence par réécrire ce terme

Ensuite on utilise le fait que la dérivée seconde de \(\phi\) est bornée par la norme du vecteur \(\phi_j\) car il s’agit d'une fonction à. La fonction \(\phi\) étant infiniment dérivable et a support compact on peut borner ce vecteur uniformément. On peut donc uniformément borner la somme dans \(B\) car la solution \(\rho_{\Delta t,\Delta x}\) est bornée sous CFL. Par conséquent

En utilisant (1.2.18) - (1.2.19) - (1.2.20) et (1.2.21). On obtient que notre somme (1.2.17) converge vers une solution faible. Pour monter que notre solution est entropique on part de

On utilise les mêmes arguments qu’au-dessus avec le fait que ma fonction test est positive pour obtenir que la convergence vers la solution entropique.

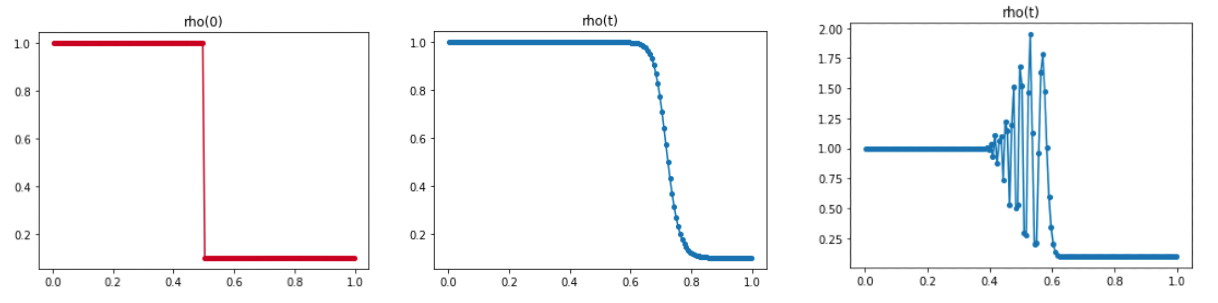

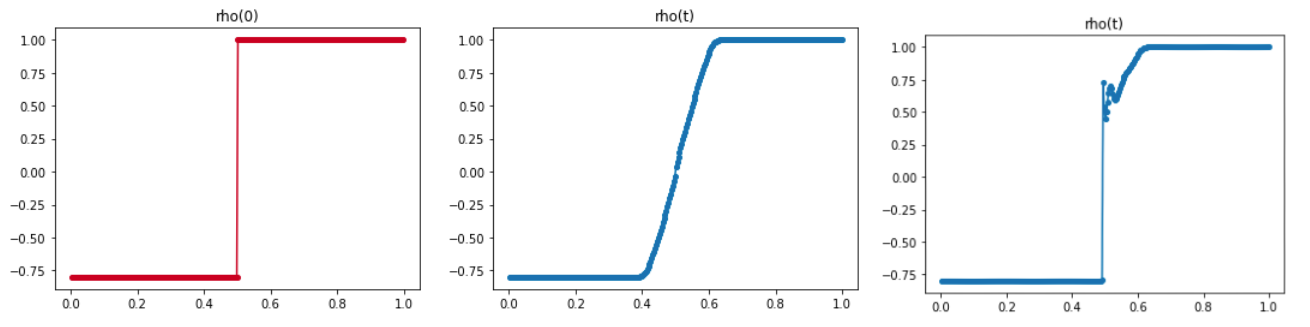

Sur la figure Figure 1.2.7 on compare un schéma entropique et un schéma non entropique pour calculer une détente pour l'équation de Burgers. On remarque que dans tous les cas le schéma entropique capture une solution de type détente. Par contre si la condition initiale passe par zéro on voit que le schéma non entropique capture un un choc stationnaire au lieu d'une détente.

Il existe beaucoup d'autres schémas comme le schéma de Godunov qui utilise la solution du problème de Riemann ou le schéma de Osher qui utilise une approche de type décentrée. Dans l'ensemble des cas, les schémas introduisent de la dissipation homogène à \(O(\Delta x)\text{.}\)

Subsection 1.2.2 Schémas en temps

Plusieurs schémas en temps peuvent être couplés avec les schémas de types volumes finis, éléments finis. On va rapidement rappeler les principales familles qui sont utilisées et qui seront aussi utilisées pour les modèles réduits. On se propose d'écrire les schémas sous une forme particulière qui nous sera utile pour la suite. Ici on résout une ODE du type

Elle peut être issue de la discrétisation d'une EDP.

Subsubsection 1.2.2.1 Méthodes de Runge-Kutta

Les méthodes de Runge-Kutta sont des méthodes d'ordre élevées qui calculent le le temps courant uniquement à partir du temps précédent. Cependant elle calculent les quantités et les flux à des temps intermédiaires.

Définition 1.2.8. Méthodes de Runge-Kutta.

La méthode de Runge Kutta s'écrit en deux étapes: une première ou on calcul un résidu solution de:

avec

et ensuite on en déduit la solution

Subsubsection 1.2.2.2 Méthodes temporelles multi-pas

Il s'agit de méthodes qui utilisent l'approximation à plusieurs pas de temps. Ici on va considérer les méthodes explicites.

Définition 1.2.9. Méthodes linéaires multi-pas.

Une méthode linéaire a \(k\) pas s'écrit en deux étapes: une première ou on calcul un résidu solution de:

avec

avec comme condition \(\sum_{j=0}^K\alpha_j=0\) et la solution est donnée par

La plus connue est la méthode d'Euler explicite ou \(K=1\) et \(\alpha_0/\beta_0=(1,0)\text{,}\) \(\alpha_1/\beta_1=(1,1)\text{.}\) La méthode d'Euler implicite correspond-elle à \(K=1\) et \(\alpha_0/\beta_0=(1,1)\text{,}\) \(\alpha_1/\beta_1=(1,0)\text{.}\) Pour finir la méthode classe de Crank-Nicolson correspond à \(K=1\) et \(\alpha_0/\beta_0=(1,\frac12)\text{,}\) \(\alpha_1/\beta_1=(1,\frac12)\text{.}\) Les méthodes dites de Adams–Bashforth, Adam-Moulton (explicites) ou BDF (implicite) rentrent dans ce cadre.

Conclusion.

Dans cette section, on a défini une classe d'EDP appelée équations hyperboliques ou loi de conservation. On a montré leurs spécificités à travers l'apparition de discontinuités et avons introduit la théorie des solutions faibles associées. On a ensuite introduit les méthodes de volumes finis pour ces EDP ainsi que leurs propriétés fondamentales. Dans un dernier temps, on a défini les schémas classiques en temps. On va maintenant aborder la question de la réduction de dimension.

../../../../CodeFrench.html#hyperbolique../../../../CodeFrench.html#hyperbolique